Biais sociaux, information positive dans la dépression et bien-être mal mesuré

On y pense, à nos biais - L'Afghanistan au plus bas - Alors faut-il mieux mesurer le bien-être ? - Le changement de croyance dans la dépression - Le responsable éthique pas si éthique - l'autisme n'est pas un spectre (abonnés)

Photo de Sydney Latham sur Unsplash

On y pense, à nos biais

L’article s’intéresse à la manière dont on détecte les biais sociaux, souvent exprimés de façon subtile mais néanmoins perçus par les personnes qui en sont la cible. Les auteurs proposent que cette détection repose sur l’inférence d’états mentaux, en comparant le comportement attendu d’un observateur impartial avec son comportement réel. Autrement dit, on détecte un biais social en comparant ce qu’on s’attend que la personne fasse avec ce qu’elle fait réellement.

Quatre expériences (N = 876) testent cette prédiction, en étudiant la capacité des participants à inférer des croyances initiales (exp. 1), des biais généraux (exp. 2), puis des biais liés à l’origine ethnique, au genre et à l’âge (exp. 3), et enfin des biais multidimensionnels (exp. 4).

Les résultats indiquent que les jugements des participants sont mieux expliqués par l’inférence des croyances antérieures d’une personne avant qu’elle n'actualise ses croyances face à de nouvelles informations. Cela suggère que les individus considèrent un observateur biaisé comme quelqu’un qui actualise ses croyances de manière rationnelle, mais à partir de mauvaises connaissances de base.

Le modèle permet aussi d’expliquer pourquoi certaines formes de microagressions ou de jugements implicites sont perçues comme révélatrices d’un biais.

En conclusion, l’article indique que la capacité humaine à reconnaître les biais sociaux repose largement sur notre faculté à raisonner sur les états mentaux d’autrui et à détecter l’écart entre croyances attendues et comportements observés.

Pré-enregistement : oui

Données accessible : oui

Asaba, M., Davis, I., Leonard, J., & Jara-Ettinger, J. (2025). Detecting social biases using mental state inference. Journal of Personality and Social Psychology, 129(4), 649–667. https://doi.org/10.1037/pspa0000451

L'Afghanistan au plus bas

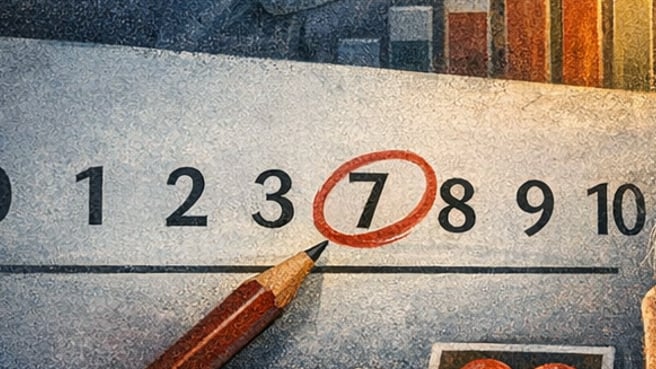

Suite à la guerre avec les États-Unis, l'Afghanistan a aujourd'hui son taux de satisfaction de vie le plus bas. Ce résultat n’est évidemment pas très étonnant, mais par contre, ce qui est intéressant, c'est de regarder où se trouve exactement l'Afghanistan sur l’étendue de cette échelle.

La plupart du temps, la satisfaction de vie se mesure sur une échelle de 0 à 10. L'Afghanistan se trouve donc aujourd'hui à 1,28, soit quasiment le plus bas possible. Et ce que je trouve vraiment intéressant, c'est d'aller regarder quels sont les pays les plus hauts.

Et le pays le plus haut, c'est le Danemark pour une moyenne de 8. Et c'est un résultat assez intéressant parce qu'il est constant. Il semblerait qu'un pays ne peut pas avoir un résultat supérieur à 8 sur 10. C'est comme s'il y avait une sorte d'effet plafond, mais cet effet plafond n'est pas lié à l'échelle. Simplement, les participants ne peuvent pas répondre psychologiquement plus de 8 sur 10 à la question « Êtes-vous heureux dans votre vie ? ». Par contre, on peut aller jusqu'à 0 dans à quel point êtes-vous malheureux dans votre vie et donc avoir un effet très très proche de 1 comme se trouve l'Afghanistan, malheureusement aujourd'hui.

Et cette asymétrie entre le fait de pouvoir noter 0 et le fait de ne pas pouvoir noter 10 en notant au maximum 8 sur 10, ça pose un énorme problème dans nos mesures de satisfaction de vie et de manière plus générale dans nos mesures de satisfaction globale. On n'a pas une symétrie autour du point central qui irait qu'on noterait de 0 à 10. En fait, on note de 0 à 8 même dans une échelle en 10 points.

Stutzman, L. D., Lun, P., Yang, M., Chan, K., & Cheung, F. (2025). Epilogue to the war: Afghanistan reports the lowest well-being in recorded history. Science Advances, 11(22). https://doi.org/10.1126/sciadv.ads4156

Alors faut-il mieux mesurer le bien-être ?

Et à ce sujet, il y a un article qui est très critique de l'utilisation des moyennes de satisfaction de vie et qui propose trois méthodes alternatives pour agréger la satisfaction de vie, avec notamment une méthode liée à la priorisation. Cette méthode se demande : qu'est-ce qu'il faudrait prioriser en bas de l'échelle pour pouvoir améliorer le score à l’échelle ?

Une deuxième méthode s’intéresse aux critères de suffisance, c’est à dire à la proportion de participants qui indiquerait être au-dessus d'un niveau de vie suffisant ou d'une satisfaction de vie suffisante.

Et la troisième s’intéresse à l'égalité, c'est-à-dire le degré d'inéquité qui va se trouver au sein du pays.

Les chercheurs se demandent si nous ne devrions pas mesurer ces trois critères pour faire un score “composite” de bien-être, afin de comparer ces trois critères à la moyenne entre les pays.

En effet, ce qui est très intéressant dans cette échelle, c'est de remarquer que pour les pays qui ne vont pas bien de base, des pays qui vivent une guerre, qui ont une histoire traumatisante, une augmentation de la qualité de vie en moyenne est liée aussi à une augmentation du nombre de personnes qui souffrent et à une augmentation de l'inégalité dans le pays. Donc finalement, dans les pays qui vont progressivement de mieux en mieux, se trouvent des gens qui vont progressivement de moins en moins bien aussi. Et cet indicateur n'est pas capturé par une échelle qui ferait juste la moyenne des personnes du pays.

Panasiuk, S. L., McCanny, A., & Cheung, F. (2025). Methods reflect values: Evaluating the shortcomings of the average for measuring population well-being. Journal of Personality and Social Psychology, 128(6), 1355–1370. https://doi.org/10.1037/pspp0000549

Le changement de croyance dans la dépression

La littérature sur la dépression indique que non seulement le contenu des croyances, mais aussi la capacité à les réajuster face à des preuves contradictoires sont importantes pour comprendre le fonctionnement de la dépression.

Cependant, une méta-analyse récente n’a révélé aucun lien entre la dépression et la capacité à réajuster ses croyances en réponse à des informations négatives. Ce lien n’apparait que quand les participants sont présentés avec des informations positives. Et ces résultats concordent avec la revue quantitative de Kube (2023), qui suggérait que, dans la mise à jour des croyances, la dépression n’est pas associée à une sensibilité excessive aux nouvelles informations négatives. On appelle d’ailleurs cette sensibilité aux informations positives l’immunisation cognitive.

L'immunisation cognitive consiste notamment à dévaloriser cognitivement les informations positives inattendues, et peut entraver la mise à jour des croyances à la lumière d'informations positives. Ainsi, il est possible que les personnes présentant des niveaux élevés de dépression réduisent la fiabilité et la valeur des informations positives ou les considèrent comme des événements exceptionnels.

Bon, tout ça c’est bien mais est ce que les auteurs ont fait un bon boulot pour étudier la littérature à leur disposition ? À mon avis, il y a de graves manquements de la part des chercheurs.

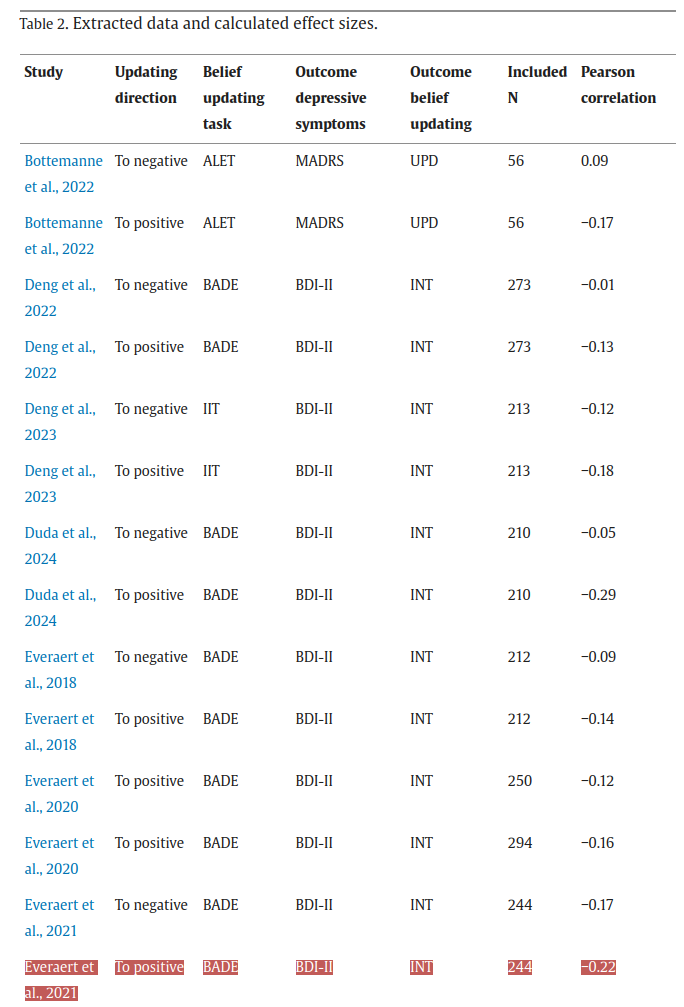

J'ai regardé le tableau 2, indiquant que le résultat le plus fort est Everaert et al., (2021). Je suis allé regarder l'article, et il semblerait que les résultats se trouvent tout en bas dans un tableau qui fait 2 pages, le tableau 2. C’est page 56 pour les curieux.

Dedans, je ne vois pas de résultat qui pourrait se transformer en -0.22. Le seul 0.22 que je vois est un odds ratio dans le tableau au-dessus, et pas un coefficient de corrélation. On peut donc faire une petite chasse au 0.22 en sachant que l'effet est significatif et est donc en gras, et en sachant que r = z/racine(z^2+244-2) le 244 étant le nombre total de participants et le 2 le degré de liberté. En fait il suffit de prendre le problème à l'envers et pour un r = 0.22 il faudrait un z score autour de 3.5.

Un control+f dans l'article montre qu'aucun résultat ne correspond. Aucun Z score ne s’approche de 3.5. J'ai peut-être fait une erreur dans mon calcul mais les chercheurs n'expliquent pas non plus ce qu'ils ont fait.

Enfin, les auteurs de la méta-analyse indiquent avoir des données ouvertes. Cependant, regardez la ligne pour Everaert :

Voilà. On en saura pas plus. Cela démontre à nouveau qu'il ne suffit pas d'avoir des données ouvertes, il faut qu'elles soient compréhensibles.

Zabag, R., Vander Zwalmen, Y., Kube, T., Hoorelbeke, K., Koster, E. H. W., & Joormann, J. (2025). Belief Updating Deficits in Depression: A Systematic Review and Meta-Analysis. Clinical Psychology Review, 121, 102649. https://doi.org/10.1016/j.cpr.2025.102649

Le responsable éthique pas si éthique

Le Journal of Biotechnology a rétracté un article vieux de 23 ans à cause d'une manipulation claire d'une image. Le problème, c'est que l'autrice principale de l'article, Iratxe Puebla, est aujourd'hui chargée de l'intégrité scientifique pour le comité d'éthique de la publication (COPE), un organisme qui aide les auteurs et éditeurs à faire rétracter les articles frauduleux (entre autre).

Cette chercheure n'a évidemment répondu ni à l'éditeur ni aux journalistes et est toujours en poste.

L’image qui fait réfléchir

L’autisme n’est pas un spectre

L’article présenté aujourd’hui porte sur une interview de la psychologue et neuroscientifique Uta Frith, une chercheuse majeure dans l’étude de l’autisme.

Après plusieurs décennies de recherche, elle remet désormais en question l’idée largement acceptée selon laquelle l’autisme constitue un « spectre ».

...